- +1

需關注AI醫療領域將出現的四種新職業

視覺中國 資料圖

在人工智能 (AI)對社會所產生的各類影響中,就業問題備受關注。在醫療領域,隨著AI逐步滲透到醫療各個環節,從診斷、治療到護理都明顯感受到了這種沖擊力。一些三甲醫院已經在積極探索“AI醫院”、“AI科室”等新運營模式。從業人員對AI情感復雜,擔心被替代。在當前強調“穩就業”“穩民生”的大環境下,這些擔憂理應受到重視。

回顧歷次技術革命,通用技術的出現總會帶來“創造性破壞”,沖擊現有社會系統,引發失業浪潮,但也會催生新職業和崗位,如MRI放射科醫生、網絡工程師等。因此,在討論AI對醫療崗位的替代性影響時,也應看到其創造新工作的潛力,這對于產業升級轉型、提供高質量工作崗位和生活保障意義重大。

一、如何理解AI對醫療崗位的影響

理解AI對醫療崗位的影響,需回歸任務本質的分析框架。MIT學者Autor提出的“常規化假說”揭示,技術進步對中等技能崗位沖擊最大。這類崗位(如檢驗科樣本分類)依賴規則明確的重復性操作,易被算法與機器人替代;而高技能抽象任務(如復雜手術決策)與低技能手工任務(如患者搬運)則因技術替代成本過高,需求不降反升,形成就業市場的“極化現象”。

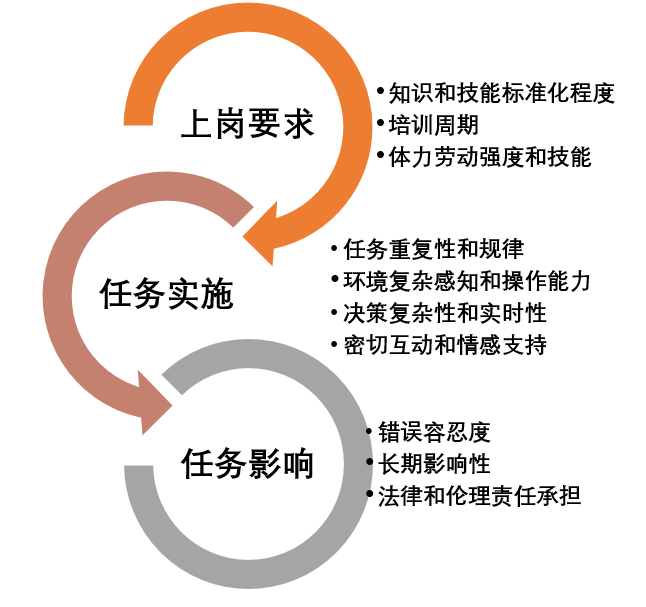

諾貝爾經濟學獎得主阿西莫格魯進一步指出,任務層級的替代性分析是預測AI影響的關鍵。醫療服務的全流程可拆解為數百項子任務,每項任務對知識類型、環境適應與責任歸屬的要求差異顯著。因此,本文將從上崗要求、實施過程和影響三個維度分析醫療工作任務的AI可替代性。

(一) 上崗要求:知識標準化與經驗壁壘

知識和技能標準化程度:AI替代的核心門檻在于任務所需知識的可編碼性。以放射科為例,肺部結節識別的影像學標準相對統一,AI通過海量數據訓練即可達到高精度診斷;而腫瘤科醫生制定化療方案時,需綜合患者基因、并發癥、藥物耐受性等動態因素,這類依賴臨床直覺的“隱性知識”難以被算法完全捕捉。

培訓周期影響替代成本:某些任務只需短期見習適應,如護士靜脈穿刺技能,500次練習后達標率可達92%。而有些任務需長期培訓和實踐,如經驗豐富的腫瘤科醫生制定治療方案,需綜合患者多種因素判斷并調整,其準確率高于僅靠AI輔助的醫生。還有些工作雖知識要求不高,但需大量實踐經驗,如資深護士憑借多年經驗判斷病情和處理突發狀況。

體力勞動的自動化邊界:醫院急救、后勤人員從事大量體力勞動,如患者移動、物資搬運等。AI可替代部分高強度體力勞動,如物流機器人運輸物資,但因醫院環境復雜、人流量大,需人工干預確保患者和物資準確到位,完全用AI替代存在困難。

(二)任務實施:從規則驅動到情境適應

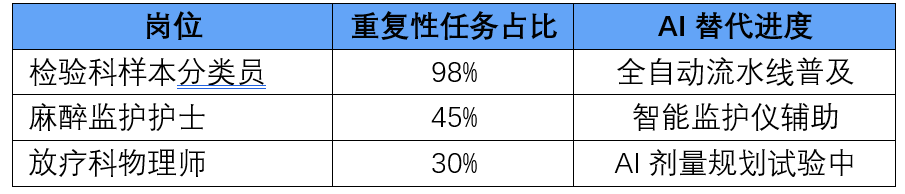

任務重復性和規律性:規則明確、流程固定的任務構成AI替代的“低垂果實”。某三甲醫院檢驗科引入全自動生化分析儀后,樣本分類效率提升300%,人力需求縮減70%。與之相對,外科醫生在腹腔鏡手術中遭遇血管變異時,需在數秒內調整操作策略,此類非結構化決策遠超當前AI的技術邊界。

表1. 不同崗位的重復性任務

參考:晶泰科技《實驗室自動化白皮書》(2023);Brown & Badrick(2022)

環境復雜感知和操作能力:在實驗室封閉環境中,相關任務更容易被AI替代,如一些手術機器人對特定手術的成功率可達99.9%。但護理機器人在病房場景的應用受阻,主因在于難以適應人流密集環境中的動態避障需求。

決策復雜性和實時性:部分任務需在短時間內做出復雜決策,且受多種動態因素影響,需強大計算能力和復雜算法,更難被AI替代。例如心臟驟停搶救需在10秒內決定除顫能量,不同患者病情和身體狀況千差萬別,需醫生靈活制定個性化治療方案,人類醫生現場決策幾乎不可替代。

人際密切互動和情感支持:如果任務執行需與人頻繁互動、提供情感支持、安慰或建立信任關系,交互復雜度較高,AI替代性低。同時,AI缺乏情感和倫理認知,在理解和處理復雜人類情感方面有局限性。典型的如護士需與患者、家屬及其他醫護人員溝通協作,建立良好人際關系,這對患者治療和康復至關重要。AI雖可承擔部分溝通任務,但無法滿足患者情感支持和倫理決策需求,更無法完全替代護士與患者的情感互動。

(三) 任務影響

錯誤容忍度:指任務失誤可能造成的損害程度與可逆性。低風險場景如健康檔案管理,AI替代較易;高風險場景如手術操作,AI替代較難。世界衛生組織報告提出“首先,不可傷害”是衛生保健服務基本原則,但現實是每10名患者中約1人在衛生保健中受傷害,每年300多萬患者因不安全醫護死亡,在低收入和中等收入國家,每100人中就有4人死于不安全醫護。因此,涉及患者安全問題成為醫療機構引進AI等新技術時最關注的事項。

長期影響性:AI側重短期數據和即時結果,難以全面評估和承擔長期影響。若醫生診斷和治療方案對患者健康和生命有長期影響,需綜合考慮患者長期健康和生活質量來制定方案,如慢性病管理,需持續數年監測患者病情并調整治療方案,這種情況下,不適宜用AI替代。

法律和倫理責任承擔:任務涉及生命權、隱私權等核心倫理范疇時,因AI無法獨立承擔責任,涉及重大倫理和法律責任的決策和任務,很難完全替代人類。例如器官移植過程需考慮倫理問題和法律規定,不能由AI獨立決策。在責任可追溯和歸因問題上,若醫療事故原因可明確歸因于技術或人為因素,則AI較易被接受;相反,在模糊責任場景下,如涉及價值觀決策,很難將責任歸咎于哪一方,AI難以完全替代人類承擔最終責任。

圖1 醫療崗位任務AI可替代性的三大維度

二、破局之道:AI醫療可能興起的四類新崗位

在醫療領域AI替代傳統崗位過程中,預計會催生出四類新型崗位,即技術增強型崗位、人機協作型崗位、倫理治理型崗位和新型服務型崗位。這些崗位包含的任務通常需要人類與AI深度協作,而非完全由AI或人類獨立完成。未來醫療領域會出現大量人-AI團隊任務協作情況,這是未來“AI醫院”重點建設方向。

1. 技術增強型崗位

針對人類能獨自完成的工作,借助AI技術助手,工作人員能更高效、高質量地完成任務,以人為主,技術為輔。

例如醫療AI訓練師,核心任務是標注醫療影像數據、優化診斷算法、構建知識圖譜。針對胸部CT的肺炎AI診斷系統訓練,需呼吸科醫生與數據工程師聯合工作,利用AI自動識別80%標準化病例,醫生負責標注數據、評估模型,數據工程師負責構建算法、優化模型。

又如數字療法設計師,核心任務是開發AI心理干預程序、構建慢性病管理算法。在針對抑郁癥患者的數字療法方面,設計者需構建AI聊天機器人,通過分析患者言語和行為,提供個性化心理支持和認知行為療法。

2. 人機協作型崗位

針對原有需團隊協作完成的工作,AI可作為團隊成員加入,形成人-AI團隊。AI可配合團隊工作,成為協調員、初審員等,使團隊更高效合作。

例如手術機器人協調員,核心任務包括術前將外科醫生操作習慣轉化為機器參數,術中監控AI視覺導航系統,接管突發狀況,術后分析機器人手術日志,優化動作庫。

還有AI診斷審核員,負責審核AI初診結果,確保診斷的準確性和可靠性。若置信度不足,則由人工標注錯誤類型并反饋至訓練系統。

3. 倫理治理型崗位

AI可作為解決方案用于其應用本身導致的問題。一般AI并不真正了解人類倫理道德規范,需經專門訓練的AI輔助人類開展審計和監督,形成“專家+AI”協作模式。

例如醫療算法審計師,需熟悉算法審計、數據隱私保護、倫理學和醫學知識。其任務包括檢測算法偏見,如皮膚癌診斷模型在深色人種的準確率偏差;評估數據隱私保護等級,進行GDPR/HIPAA合規性驗證;建立可解釋性標準,如X光診斷AI的決策路徑可視化等。

人機責任界定專員是法學與醫學的交叉崗位,主要任務包括手術機器人事故溯源,區分機械故障(廠商責任)還是操作失誤(醫生責任);以及AI用藥推薦糾紛,判定算法缺陷(訓練數據不足)還是臨床誤用(超適應癥使用)。

4. 新型服務型崗位

AI應用深入會激發出全新產品和服務,涌現出很多創業公司和全新的崗位。

例如數字孿生健康管家,需掌握醫學知識、AI技術、用戶體驗設計等知識。其任務包括通過AI構建患者虛擬化身,模擬不同治療方案效果,需人類專家解讀模擬結果,設計“治療沙盤推演”。

AI醫療設備運維工程師,需掌握電子工程、計算機技術和醫療設備維護知識。其任務是負責維護智能手術機器人、AI影像設備、遠程診療系統的軟硬件運行,處理設備與AI平臺的數據交互故障。

三、相關建議

AI在醫療領域的應用牽涉面廣泛,未來將成為醫療健康服務流程中的“智能伙伴”,對從業者的角色定位、能力要求以及行業的整體人才戰略產生顛覆性影響。為引導這場變革朝著積極方向發展,本文提供分析框架和醫療新崗位技術預判,供醫療機構和從業人員參考。而要構建AI賦能、人機協同、高效、公平、人性化的醫療大健康新生態,主管部門應采取以下措施:

一是跟蹤AI醫療的現實應用,更新變革原有政策法規,鼓勵創業。在上位法缺失情況下,上海可先行先試,進行“AI醫療責任”立法試點,補充完善現有《醫療事故處理條例》空白,要求AI系統記錄完整決策日志,確保可追溯性,區分算法缺陷責任與臨床誤用責任等不同責任類別。

二是推出積極勞動力市場政策,緩解AI帶來的就業結構性沖擊。一方面,鼓勵醫療機構和企業創造新AI醫療相關崗位,調整偏重AI技術的稅收和補貼政策,改成為企業凈增新崗位提供更多激勵;另一方面,為面臨失業風險的醫療人員提供技能再培訓和轉崗支持,幫助他們適應新工作環境。

三是推動教育改革,適應AI醫療新要求。醫學院相關專業需增加《醫療AI系統原理》《人機協作診療實務》等必修課程,臨床實習階段需增加AI工具操作認證。強化批判性思維和創新能力培養,推動終身學習和技能升級,鼓勵跨學科交叉學習,培養具備多學科知識的復合型人才。

四是高度關注AI倫理問題。強制醫療機構設立人工智能倫理相關機構和一定比例的倫理審核崗位(例如規定AI應用每達到一定數量,需要新增1個倫理審核崗位),定期、系統性地審查AI應用方案。建立“算法影響評估”制度,避免災難性的后果。

(作者趙付春系上海社會科學院信息所副研究員;AI醫療創新研究中心黃浩、顧文兵對此文亦有貢獻)

- 報料熱線: 021-962866

- 報料郵箱: news@thepaper.cn

互聯網新聞信息服務許可證:31120170006

增值電信業務經營許可證:滬B2-2017116

? 2014-2025 上海東方報業有限公司