- +1

警惕!AI詐騙正在全國爆發,科技公司老板被騙430萬

來源丨元宇宙簡史

作者丨元宇宙簡史主理人 Fun

【元宇宙導讀】隨著AI技術的發展和應用,網絡詐騙也出現了新的手法和變化。近日,福州市某科技公司法人代表郭先生在與“好友”視頻聊天時,被對方以借用賬戶轉賬為由,10分鐘內被騙走430萬元。這是一起典型的AI詐騙案件,也是目前全國范圍內正在爆發的一種新型詐騙方式。本文將分析AI詐騙的原理、特點、危害和防范措施,以期提高公眾的安全意識和防范能力。

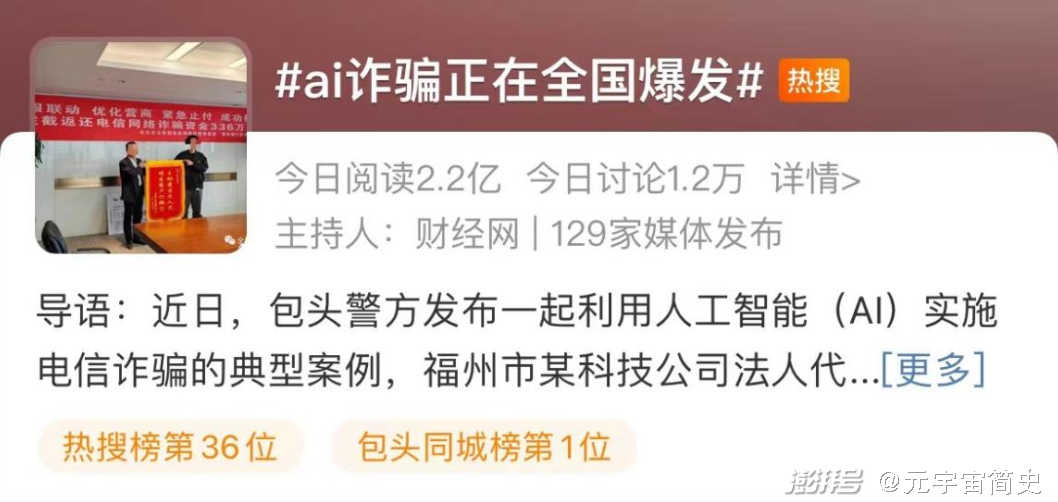

近日,一條令人震驚的消息登上了微博熱搜榜:AI詐騙正在全國爆發。

據報道,福州市某科技公司法人代表郭先生,在與好友視頻聊天時,被對方以借用賬戶轉賬為由,10分鐘內騙走了430萬元。事后才發現,視頻中的好友其實是騙子利用AI換臉和擬聲技術偽造的。

這是近期全國范圍內出現的一種新型電信詐騙,該詐騙利用AI人工智能,通過“換臉”和“擬聲”技術模仿受害人的朋友或親戚的聲音和外貌,以此騙取受害者的信任,進行網絡詐騙。

據包頭警方介紹,這種詐騙的成功率高達100%,已經造成了多起重大經濟損失。

01、430萬AI詐騙案件始末

郭先生是福州市一家科技公司的法人代表,他在4月20日11時40分左右收到了一個微信視頻電話,是他的好友打來的。

好友跟他聊了幾句,然后說自己有個朋友在外地參加投標,需要借用郭先生公司的公對公賬戶轉430萬元保證金。好友還給郭先生發了銀行轉賬單的截圖,說已經把錢打到了郭先生的賬戶上。

郭先生看了視頻,覺得好友的面貌和聲音都沒有問題,就沒有去核實賬戶是否收到錢,于11時49分分兩次把430萬元轉給了好友指定的賬戶。

轉完錢后,郭先生給好友發了微信消息,告訴他已經辦好了。沒想到,好友回復了一個問號。

郭先生趕緊打電話給好友,才知道好友根本不知道這件事。原來,對方利用智能AI換臉技術,冒充好友對他進行了詐騙。

“他一直沒有跟我說要借錢,只說會先把錢打給我,再讓我轉給他朋友。而且視頻里面我也認出了他的長相和聲音,所以我就沒有多想”,郭先生說。

4月20日12時21分,福州市公安局刑偵支隊向包頭市公安局電信網絡犯罪偵查局發出外協請求,稱福建省一位知名民營企業負責人被騙走430萬元,而涉案的銀行卡是包頭市蒙商銀行的對公賬戶,請求包頭警方盡快進行止付處理。

包頭市公安局電信網絡犯罪偵查局立刻啟動“包頭市警銀聯動綠色查詢機制”,當班民警迅速完成核查、報審程序,并第一時間將涉案卡的信息通報給蒙商銀行相關部門。

在銀行的大力配合下,僅用10分鐘,就成功攔截了該詐騙賬戶內的336.84萬元被騙資金。同時,向福州市公安局警方提供了剩余款項93.16萬元資金流出信息,為進一步追查該案剩余資金提供了重要線索。

目前,福建警方與包頭警方正在全力追繳剩余資金中。

02、AI詐騙原理解析

AI換臉和擬聲技術是人工智能技術在圖像和語音領域的重要應用之一,它們可以通過深度學習算法,從大量數據中提取特征,并生成逼真的圖像和語音。

AI換臉技術可以將一個人臉圖像中的面部特征替換成另一個人臉圖像中的面部特征,并保持原圖像中其他部分不變。例如,可以將一個人臉圖像中的眼睛、鼻子、嘴巴等替換成另一個人臉圖像中對應部位的眼睛、鼻子、嘴巴,而發型可以保持不變。

AI擬聲技術可以根據一個人語音樣本中的音色、語調、節奏等特征生成與其相似或相同的語音,并可以根據輸入文本合成任意內容的語音。例如,可以根據一個人的說話錄音,生成與其相同或相似的聲音,然后你可以用這個聲音去和任何人交談。

正常情況下,AI換臉和擬聲技術可以為我們帶來極大的便利,特別是可以提高影視行業的效率降低其成本,但如果被不法分子利用,則可能造成嚴重后果。

03、部分典型的AI詐騙案例

2022年2月,浙江溫州市公安局甌海分局接到報案稱,一名陳先生被“好友”詐騙了近5萬元。騙子利用陳先生好友在社交平臺發布的視頻,截取其面部視頻畫面后再利用“AI換臉”技術合成,制造陳先生與“好友”視頻聊天的假象騙取其信任。

2021年4月,上海某公司高管因對方使用AI換臉與人工生成的語音技術制作公司領導的面孔,并要該高管轉賬,致使該高管被詐騙150萬元。

2021年,常德網警巡查發布消息,AI技術改變詐騙,新騙局來襲后,詐騙成功率竟接近100%。騙子利用AI換臉技術,將自己置換成視頻、電視劇中的男(女)主角,并通過社交軟件與受害者聊天,以情感為誘餌進行詐騙。

2020年12月,廣東深圳市某大學生小李在網上認識了一名女網友,并與其視頻聊天。不料,對方利用AI換臉技術,將小李視頻中的面部合成到不雅視頻中,并以此威脅小李支付5萬元封口費。小李拒絕后,對方將不雅視頻發送給了小李的親友,造成了嚴重的社會影響。

04、AI詐騙是如何實施的?

AI詐騙的實施過程大致分為以下幾個步驟:

1、騙子通過各種渠道收集受害人及其熟人的信息,如姓名、電話、社交賬號、照片、視頻等;

2、騙子利用AI換臉技術,將自己或他人的面部替換成受害人熟人的面部,并利用AI擬聲技術,將自己或他人的聲音轉變成受害人熟人的聲音;

3、騙子通過社交軟件或電話聯系受害人,并以視頻方式進行信息確認,讓受害人放松警惕;

4、騙子以各種理由誘導受害人轉賬匯款,如借錢、投資、緊急救助等,并催促受害人盡快操作;

5、騙子在收到錢款后立即消失,切斷與受害人的聯系。

05、AI詐騙有何特點?

AI詐騙相比傳統的電信詐騙,有以下幾個特點:

- 更加隱蔽和逼真。通過AI換臉和擬聲技術,騙子可以輕易地偽裝成任何人,并與受害人進行視頻通話,讓受害人無法辨別真偽;

- 更加高效和精準。通過AI技術分析公眾發布在網上的各類信息,騙子可以快速地篩選出目標人群,并根據不同情況制定定制化的詐騙腳本,從而提高詐騙成功率;

- 更加難以防范和追查。由于AI換臉和擬聲技術生成的內容很難被檢測和辨認,受害人往往在事后才發現被騙,并且難以找到證據和線索。同時,由于騙子使用虛假或盜用的身份信息和賬戶信息進行轉賬匯款,也增加了警方追繳資金和抓捕嫌疑人的難度。

06、如何防范AI詐騙?

面對日益猖獗的AI詐騙,我們應該如何提高安全防范意識,避免上當受騙呢?以下是一些防范建議:

- 不輕信陌生電話或視頻。如果有陌生人或熟人通過電話或視頻聯系你,并要求你提供個人信息或轉賬匯款,要保持警惕,并通過其他方式核實對方身份;

- 不隨意透露個人信息或資產情況。不要在網上公開或分享過多的個人信息或資產情況,如姓名、電話、地址、出生日期、銀行卡號、驗證碼等,以免被不法分子利用;

- 不貪圖小利或同情心。不要輕信陌生人或熟人給你介紹的投資理財項目、中獎信息、緊急救助等,并要求你轉賬匯款。如果有疑問或感覺異常,要及時報警求助;

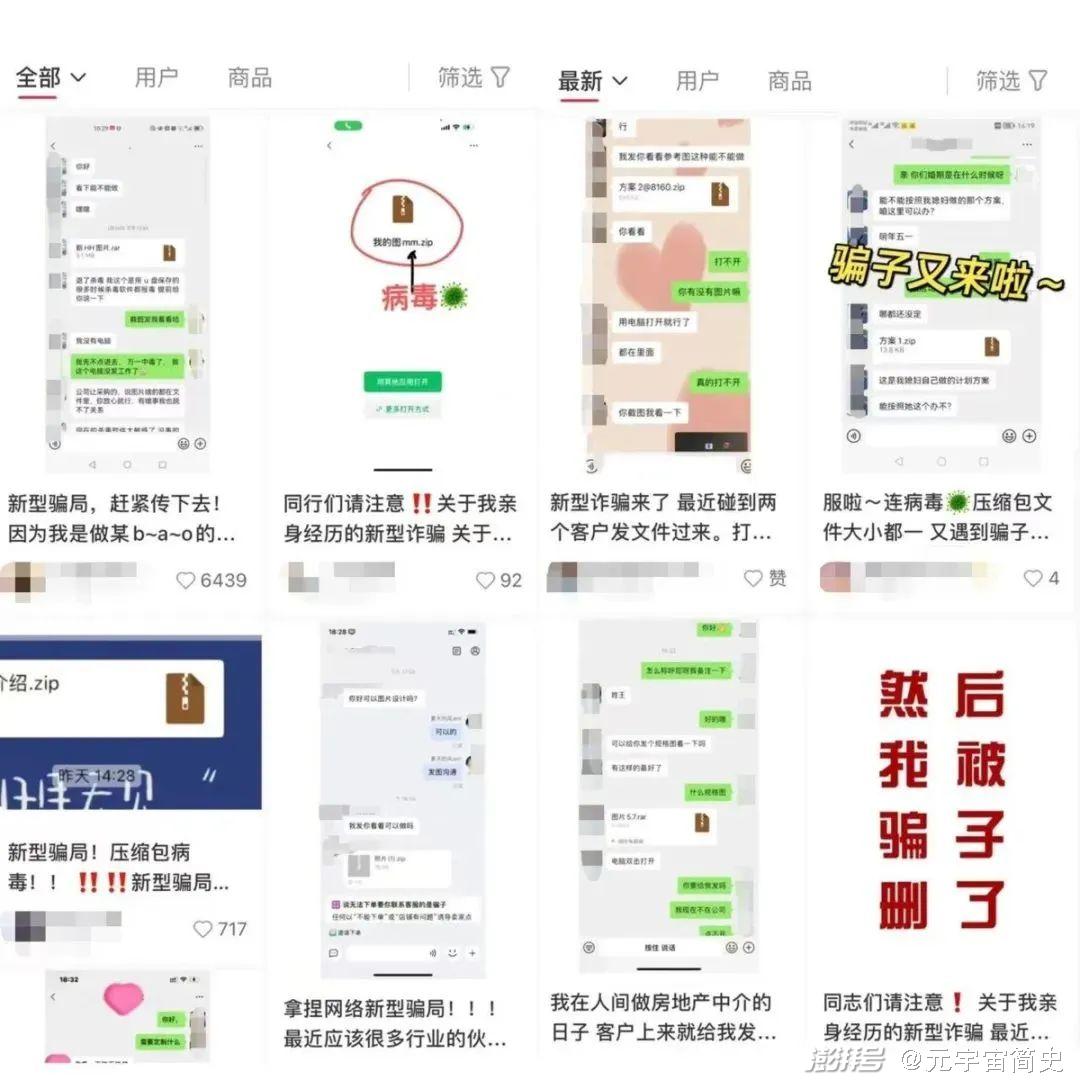

- 不下載未知軟件或點擊可疑鏈接。不要隨意下載未知來源或非正規渠道的軟件或應用程序,并要定期檢查手機、電腦是否中毒。不要輕易點擊來自陌生人或熟人發送的可疑鏈接,并要注意保護自己的社交賬號密碼;

- 不參與非法活動或違規操作。不要為了賺取傭金或回報而參與非法活動或違規操作,如代開發票、代收貨款、代購物品等,并要注意保護自己的銀行卡和支付賬戶。

總之,在AI技術飛速發展日益普及的今天,我們應該充分利用其帶來的便利和效率,同時也要警惕其可能帶來的風險和危害。只有提高自身安全意識和防范能力,才能有效地避免成為AI詐騙的受害者。

嚴正聲明:本文為元宇宙簡史原創,未經授權禁止轉載!內容僅供參考交流,不構成任何投資建議。任何讀者若據此進行投資決策,風險自擔。

本文為澎湃號作者或機構在澎湃新聞上傳并發布,僅代表該作者或機構觀點,不代表澎湃新聞的觀點或立場,澎湃新聞僅提供信息發布平臺。申請澎湃號請用電腦訪問http://renzheng.thepaper.cn。

- 報料熱線: 021-962866

- 報料郵箱: news@thepaper.cn

互聯網新聞信息服務許可證:31120170006

增值電信業務經營許可證:滬B2-2017116

? 2014-2025 上海東方報業有限公司