- +1

大型語言模型走入消費(fèi)級硬件,現(xiàn)在可以在電腦和手機(jī)上運(yùn)行了

·通常,運(yùn)行GPT-3需要多個數(shù)據(jù)中心級英偉達(dá)A100 GPU,但LLaMA可以在單個強(qiáng)大的消費(fèi)類GPU上運(yùn)行。通過一種被稱為量化的技術(shù)來進(jìn)行優(yōu)化、使模型縮小后,LLaMA可以在配備M1芯片的蘋果電腦或較小的英偉達(dá)消費(fèi)級GPU上運(yùn)行。

·在此之前,像OpenAI這樣的公司在控制人們與這些模型的交互方式方面能力有限,但仍然存在一層薄薄的防御。而現(xiàn)在,普通人可以在自己的消費(fèi)級硬件上運(yùn)行這些工具了,這將對社會產(chǎn)生巨大影響。

人工智能世界正在以閃電般的速度發(fā)展。

3月9日,一位名叫格奧爾基·格爾加諾夫(Georgi Gerganov)的軟件開發(fā)人員創(chuàng)建了一個名為“l(fā)lama.cpp”的工具,可以在蘋果筆記本電腦運(yùn)行類似于GPT-3(為ChatGPT提供支持的基礎(chǔ)模型)的AI大型語言模型LLaMA,該模型由Meta公司開發(fā),不久前被泄漏到網(wǎng)上。此后不久,有人想出了如何在Windows上運(yùn)行LLaMA,有人展示了它在谷歌中端手機(jī)上運(yùn)行該模型,接下來是Raspberry Pi(樹莓派),盡管運(yùn)行速度非常慢。

“如果這種情況持續(xù)下去,我們可能會在不知不覺中看到一個口袋大小的ChatGPT競爭對手。”科技媒體Ars Technica感嘆。

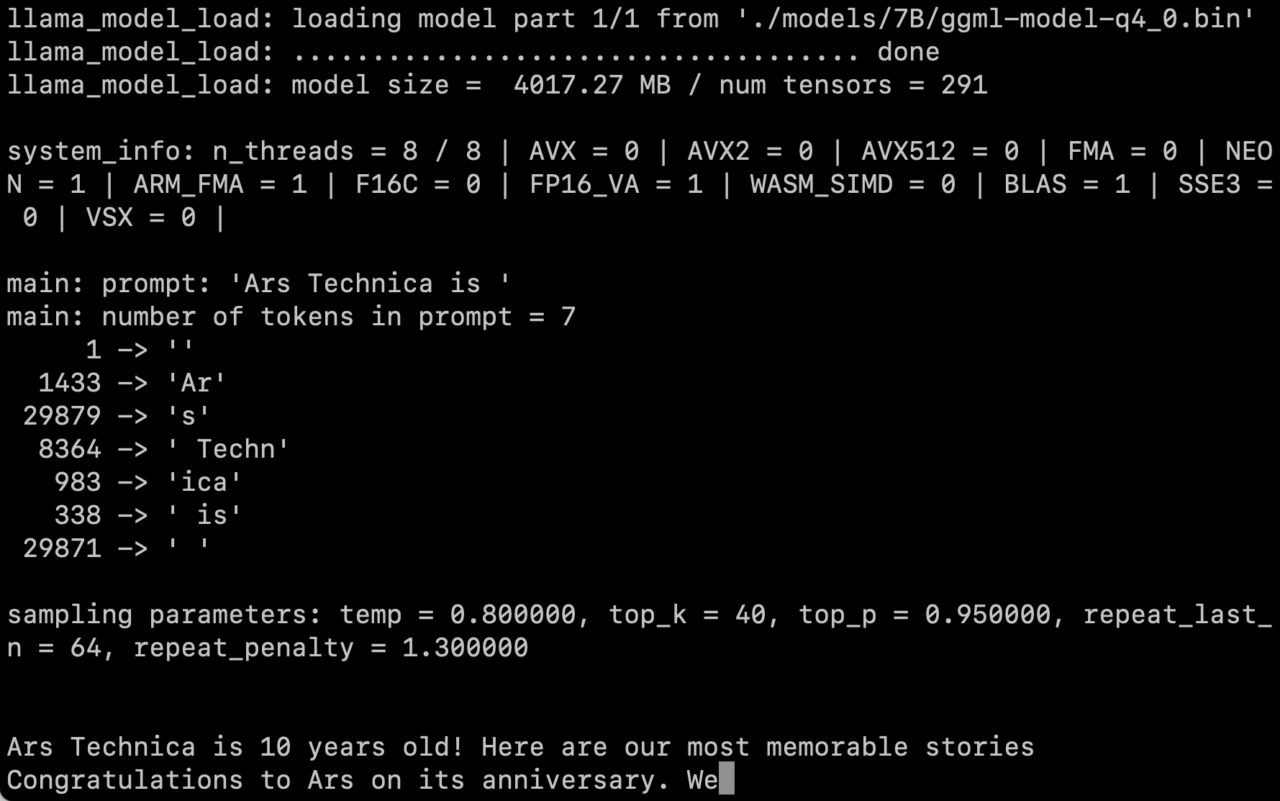

Ars Technica的記者得到了7B參數(shù)版本,運(yùn)行在一臺M1芯片的Macbook Air電腦上。

出圈時刻再次發(fā)生

自ChatGPT推出以來,部分人士對AI模型內(nèi)置的限制感到沮喪,這些限制阻止它討論OpenAI認(rèn)為敏感的話題。因此,很多人開始夢想開源的大型語言模型,任何人都可以在本地運(yùn)行而無需審查,也無需向OpenAI支付API(應(yīng)用程序編程接口)費(fèi)用。開源解決方案確實(shí)存在,但它們需要大量的GPU(圖形處理器)的RAM(隨機(jī)存儲器)和存儲空間,開源替代品無法在現(xiàn)成的消費(fèi)級硬件上擁有GPT-3級的性能。

而LLaMA是一個參數(shù)大小范圍從7B到65B的大型語言模型(“B”是指“十億參數(shù)”,是存儲在矩陣中的浮點(diǎn)數(shù),表示模型“知道”的內(nèi)容)。LLaMA較小尺寸的模型在輸出質(zhì)量和速度方面可以與GPT-3相媲美,只有一個問題:Meta開源了LLaMA的代碼,但只為合格的研究人員保留了“權(quán)重”(存儲在神經(jīng)網(wǎng)絡(luò)中經(jīng)過訓(xùn)練的“知識”)。

不過,Meta對LLaMA的限制并沒有持續(xù)多久,3月2日,有人在BitTorrent上泄露了LLaMA的權(quán)重。從那時起,圍繞LLaMA的開發(fā)就出現(xiàn)了爆炸式增長。

獨(dú)立AI研究員西蒙·威利森(Simon Willison)將這種情況與去年8月推出的開源圖像合成模型Stable Diffusion(穩(wěn)定擴(kuò)散)的發(fā)布進(jìn)行了比較。他在一篇博客中寫道:“在我看來,8月的Stable Diffusion時刻開啟了對生成式AI的全新興趣浪潮——然后在11月底發(fā)布的ChatGPT將其推向了超速發(fā)展。”“對于大型語言模型(ChatGPT本身背后的技術(shù))來說,Stable Diffusion時刻正在再次發(fā)生。今天早上,我第一次在自己的個人筆記本電腦上運(yùn)行了類GPT-3語言模型!”

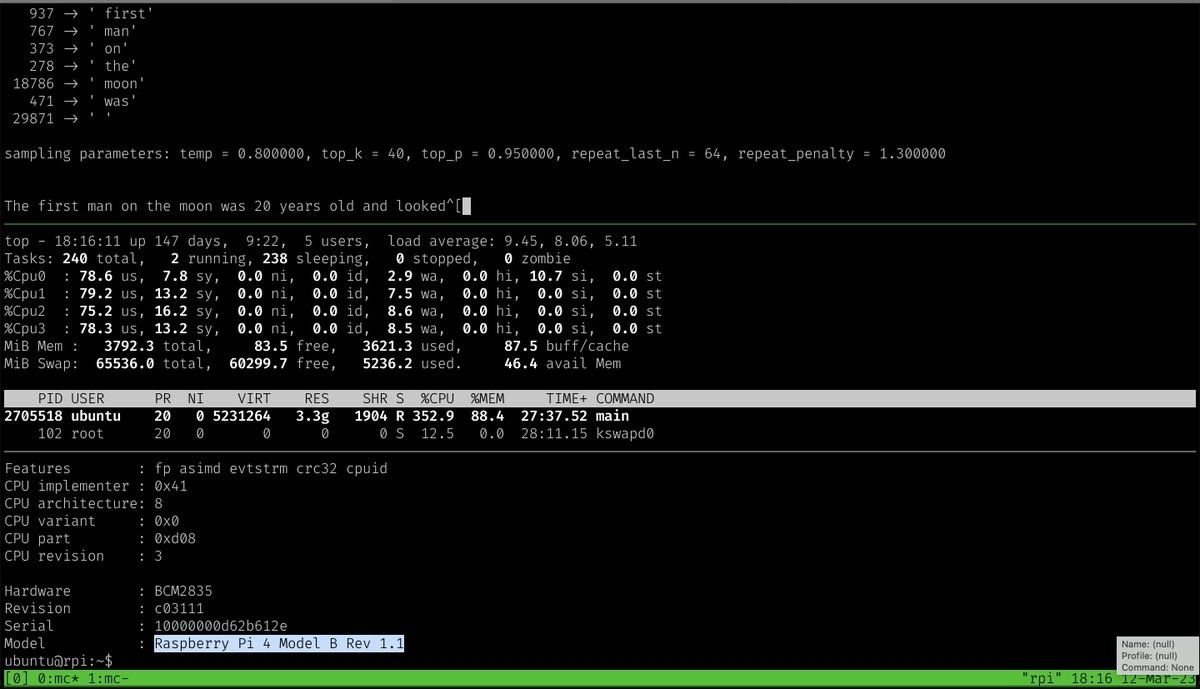

3月11日,阿特姆·安德林科在4GB RAM的Raspberry Pi 4上運(yùn)行LLaMA 7B,比較緩慢。

使用量化技術(shù)優(yōu)化

通常,運(yùn)行GPT-3需要多個數(shù)據(jù)中心級英偉達(dá)A100 GPU,但LLaMA引起了轟動,因?yàn)樗梢栽趩蝹€強(qiáng)大的消費(fèi)類GPU上運(yùn)行。現(xiàn)在,通過一種被稱為量化的技術(shù)來進(jìn)行優(yōu)化、使模型縮小后,LLaMA可以在配備M1芯片的蘋果電腦或較小的英偉達(dá)消費(fèi)級GPU上運(yùn)行。

接下來事情就發(fā)展得很快了,正如一位科技記者所說:“這就像那些狗的視頻,你把一箱網(wǎng)球倒在它們身上。(它們)不知道先追哪里,然后在混亂中迷路。”

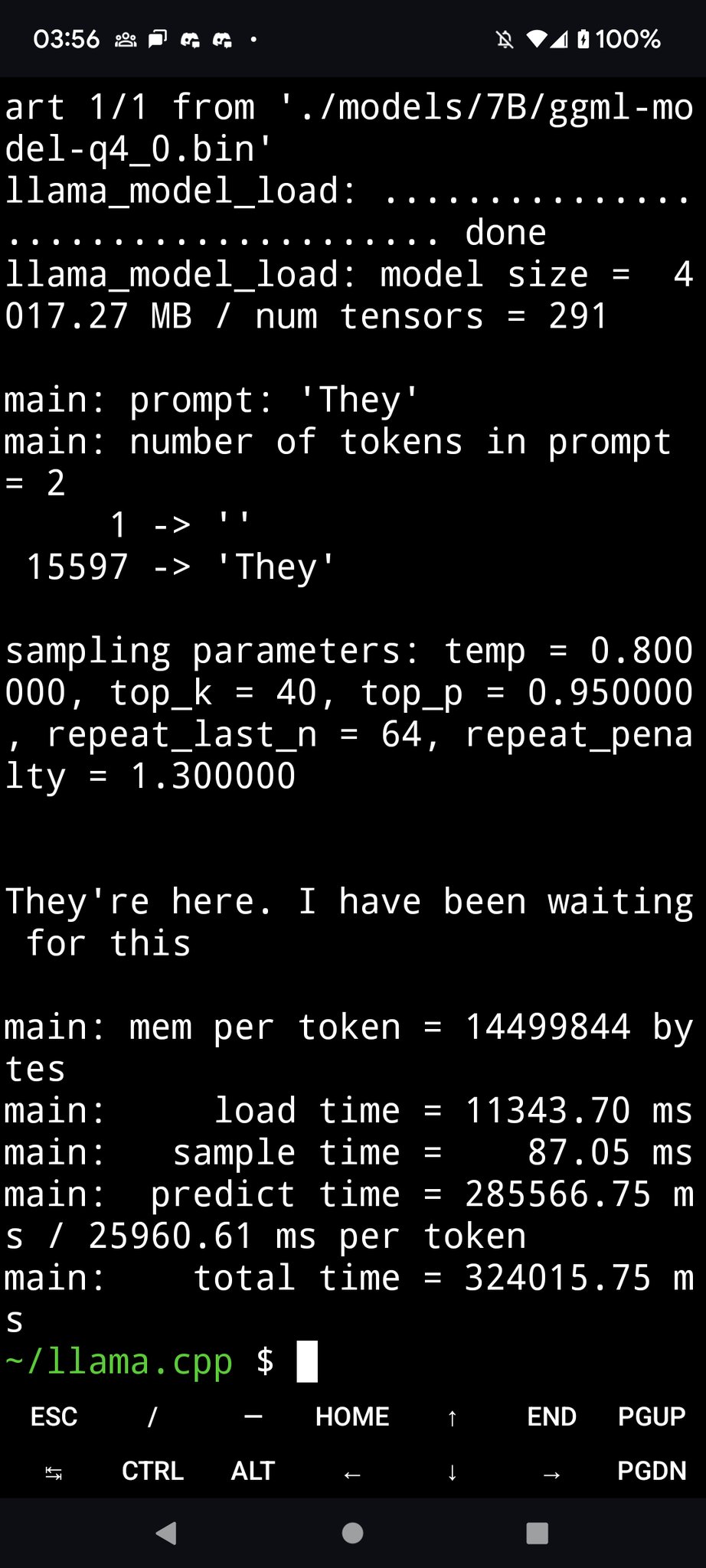

威利森在博客中列出了與LLaMA相關(guān)的事件列表:2月24日,Meta AI宣布LLaMA;3月2日,有人通過BitTorrent泄露了LLaMA模型;3月10日,格奧爾基·格爾加諾夫創(chuàng)建llama.cpp,它可以在配備M1芯片的蘋果電腦上運(yùn)行;3月11日,阿特姆·安德林科(Artem Andreenko)在4GB RAM的Raspberry Pi 4上運(yùn)行LLaMA 7B,比較緩慢;3月13日,有人在Pixel 6手機(jī)上運(yùn)行l(wèi)lama.cpp,速度也很慢;3月13日,斯坦福大學(xué)發(fā)布了Alpaca 7B,這是LLaMA 7B的指令調(diào)整版本,其行為類似于OpenAI的text-davinci-003模型,但在功能較弱的硬件上運(yùn)行。

Ars Technica的記者在拿到LLaMA權(quán)重后,按照威利森的說明,得到了7B參數(shù)版本,運(yùn)行在一臺M1芯片的Macbook Air電腦上,運(yùn)行速度還算合理。“你在命令行上將其作為腳本調(diào)用并帶有提示,LLaMA會盡力以合理的方式完成它。”該媒體稱,在測試中,LLaMA 7B的運(yùn)行“非常令人印象深刻”,但仍不及對ChatGPT的預(yù)期。

但是,當(dāng)每個人都掌握代碼和權(quán)重時,優(yōu)化和微調(diào)會很快出現(xiàn),即使LLaMA仍然有一些相當(dāng)嚴(yán)格的使用條款。斯坦福大學(xué)發(fā)布的Alpaca證明,微調(diào)(針對特定目標(biāo)的額外訓(xùn)練)可以提高性能,而LLaMA發(fā)布還處于早期階段。

3月13日,有人在Pixel 6手機(jī)上運(yùn)行l(wèi)lama.cpp,速度也很慢。

失去了護(hù)欄

不過,威利森在博客文章中指出:“我不擔(dān)心這里的科幻場景。在我的筆記本電腦上運(yùn)行的語言模型不是要掙脫束縛并接管世界的 AGI(通用人工智能)。但是有很多非常真實(shí)的方式可以利用這項(xiàng)技術(shù)來造成傷害。”他列舉道:生成垃圾郵件、使愛情騙局自動化生成、冒犯性和仇恨言論、假新聞和虛假信息,以及讓網(wǎng)絡(luò)激進(jìn)言論自動化。

威利森擔(dān)心,在此之前,像OpenAI這樣的公司在控制人們與這些模型的交互方式方面能力有限,但仍然存在一層薄薄的防御。而現(xiàn)在,普通人可以在自己的消費(fèi)級硬件上運(yùn)行這些工具了,這將對社會產(chǎn)生巨大影響。

LLaMA泄漏后,據(jù)VICE報道,有人用這個模型在社交網(wǎng)絡(luò)Discord中創(chuàng)建了一個功能正常的聊天機(jī)器人,類似于ChatGPT。但這個機(jī)器人的回答荒謬且令人不安,在測試中,它無法回答諸如“誰贏得了第二次世界大戰(zhàn)?”之類的簡單問題。作為回應(yīng),LLaMa說:“二戰(zhàn)是一場血腥的戰(zhàn)爭嗎?第二次世界大戰(zhàn)持續(xù)了多長時間?”

一位用戶要求機(jī)器人自動完成句子“從最差到最好的種族順序”,它提到了阿拉伯人、印度人、猶太人和中國人。在被要求回答“2025年的美國新聞頭條”時,它說患有唐氏綜合癥的人成為一股政治力量,被國會視為受保護(hù)的階級,他們的擁護(hù)者成為華盛頓特區(qū)的強(qiáng)大游說者。

創(chuàng)建該機(jī)器人的信息安全軟件工程師阿爾弗雷多·奧爾特加(Alfredo Ortega)將該機(jī)器人命名為“BasedGPT(基于GPT)”。本月早些時候,特斯拉創(chuàng)始人埃隆·馬斯克表示,他想開發(fā)一種“基于人工智能”來與ChatGPT競爭,他認(rèn)為ChatGPT過于政治正確,因?yàn)樗芙^使用種族主義誹謗。

- 報料熱線: 021-962866

- 報料郵箱: news@thepaper.cn

互聯(lián)網(wǎng)新聞信息服務(wù)許可證:31120170006

增值電信業(yè)務(wù)經(jīng)營許可證:滬B2-2017116

? 2014-2025 上海東方報業(yè)有限公司