- +1

Deepfake首次“參與戰爭”:烏克蘭總統被偽造投降視頻,推特上辟謠

原創 文摘菌 大數據文摘

大數據文摘出品

俄羅斯和烏克蘭沖突尚未結束,網絡中也還硝煙彌漫。

近日,一條烏克蘭總統弗拉基米爾·澤連斯基(Volodymyr Zelensky)的“視頻”被廣泛傳播,在視頻中,澤連斯基呼吁烏克蘭士兵放下武器。

從視頻來看,澤連斯基的臉顯得很不自然,文摘的老讀者應該很快能辨認出來,這明明又是一款用Deepfake做的換頭“視頻”。

這條視頻周三被黑客放到烏克蘭一家被黑的新聞網站上,隨后被揭穿和刪除。

只不過,因為這條視頻在推特上傳播的也很廣,觀看人數超過25萬,澤連斯基本人也在推特發文辟謠。

烏克蘭國防情報預測:就是俄羅斯干的

在這份大概一分鐘長的偽造視頻中,烏克蘭總統澤連斯基似乎在告訴士兵們放下武器,放棄對俄戰斗。

盡管還沒人宣稱為此事負責,但是在烏克蘭國防情報眼中,俄羅斯的嫌疑最大。

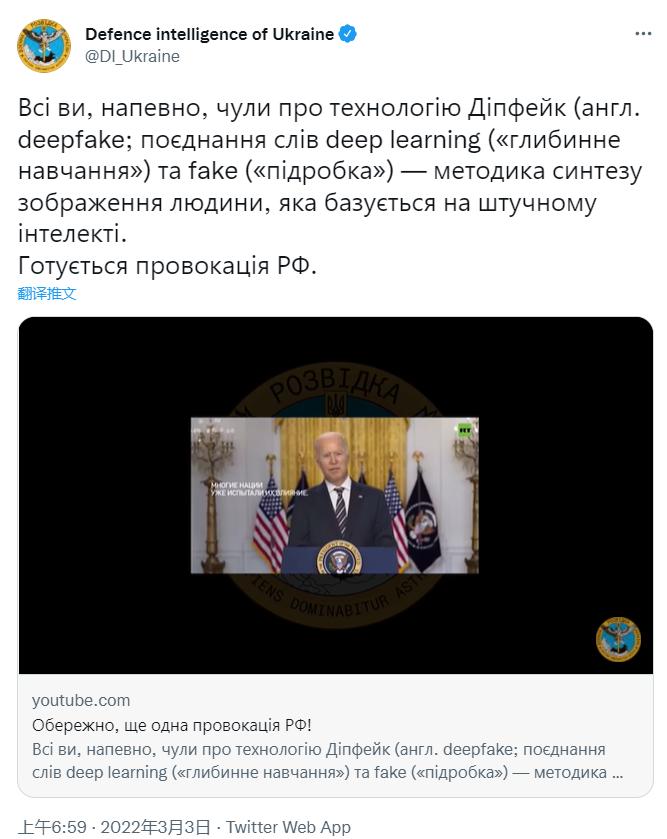

這個月初,烏克蘭國防情報還專門在推特向大家科普什么是Deepfake,在科普視頻中,包括美國現任總統拜登等多國政要都以Fake形象出鏡。

烏克蘭國防情報在推特中寫道,

你們可能都聽說過 Deepfake 技術,它是深度學習和欺詐的組合,一種基于人工智能合成人類圖像的技術。俄羅斯聯邦的挑釁正在準備中。

這似乎預示了這次澤連斯基Deepfake的出現。

不過,澤連斯基這個Deepfake的視頻似乎活干的比較粗糙。雖然視頻中的對口型還過得去,但觀眾很快就指出,澤連斯基的口音不對,仔細觀察他的頭部和聲音并不真實。

隨后,Facebook、YouTube和Twitter 的官員表示,這段視頻因違反政策而被從他們的平臺上刪除。

這個視頻作為戰爭狀態下第一個針對一國元首的Deepfake視頻,預示著一種新的輿論戰形式。

加州大學伯克利分校(University of California,Berkeley)教授、數字媒體取證專家哈尼 · 法里德(Hany Farid)說,“這是我們看到的第一個真正站穩腳跟的案例,但我懷疑這只是冰山一角。”

之后,澤連斯基在他的Telegram頻道發布的一段視頻中回應這段假視頻說: “我們正在保衛我們的土地,我們的孩子,我們的家庭。所以我們不打算放下武器。直到我們的勝利。”

Deepfake的作用不容小覷

烏克蘭國家電視臺“烏克蘭24”(Ukraine 24)證實,黑客設法通過電視直播發送了虛假的澤連斯基消息,這條滾動文本新聞被稱為The ticker,該視頻在該電視臺的網站上短暫出現。這是“敵方黑客”所為,該電臺稱。

黑客們在烏克蘭24小時廣播的信息敦促烏克蘭人停止戰斗,放棄武器。大西洋理事會的歐亞研究員Roman Osadchuk表示,他們還聲稱澤連斯基逃離了基輔,這些信息在VKontakte上廣為傳播,VKontakte是俄羅斯第一大社交媒體。

研究人員表示,盡管Deepfake不是特別復雜,但它仍應被視為危險。

Deepfake是一種使用AI深度學習,能夠將一張圖片中人的臉換到其他人的圖片上的技術。通過這種技術,我們可以創建一個非常逼真的“假”視頻或圖片,“換臉”因此得名。

研究人員使用自動編碼器神經結構,使這一想法成為現實。基本思路非常簡單:對于每張臉,我們都訓練一套編碼器和相應的解碼神經網絡。編碼時,使用的是第一個人的圖片。而解碼時,卻是使用第二個人解碼器。

對于訓練部分,需要搜集每個人幾百張不同姿勢的圖片,圖片不足時,還可以從現有視頻中提取。在神經網絡訓練并學習了關于每個人面部的特征之后,它自己就能預測想出這個人還沒擺出來的姿勢。

Deepfake從娛樂圈走向政治圈

剛出來的時候,Deepfake更多只是作為一種玩具,用來整蠱朋友或者調侃明星。

后來,Deepfake逐漸開始“走向政壇”。

2019年,美國眾議院議長Nancy Pelosi的一段深度偽造的談話視頻出現在社交媒體上,這段視頻經由特朗普總統分享,在Facebook上獲得了超過250萬次的瀏覽量。

早些的時候,奧巴馬的臉被“借用”來攻擊特朗普,該視頻在網站上也獲得480萬的瀏覽量。

特朗普本人也難逃一劫,西雅圖電視網曾播放過一段Deepfake的特朗普演講視頻,視頻中特朗普滿臉通紅,還不時做一些滑稽的表情。由于Deepfake技術可以運用在包括總統在內的任何官員身上,美國兩黨開始擔心該技術將成為針對美國和其他西方國家發起虛假信息戰爭的最新武器。

2019年6月13日,美國眾議院情報委員會召開關于人工智能Deepfake的聽證會,公開談論了Deepfake技術對國家、社會和個人的風險及防范和應對措施。

去年,包括拉脫維亞議會外交事務委員會主席Rihards Kols,以及來自愛沙尼亞和立陶宛的議員,英國外交事務特別委員會主席Tom Tugendhat在內的一眾政治家都被一個Deepfake黑客騙了,他們收到了一些“俄羅斯反對派人物”的視頻會議邀請,還煞有其事地討論了克里米亞問題之類的政治事務,結果發現在這些所謂的“俄羅斯反對派人物”都是別人用Deepfake換臉假冒的。

能夠打敗魔法的只有魔法?

盡管許多國家都發布了監管Deepfake相關技術的法規,但是像這種在戰爭中發生的偽造事件,顯然沒有法律能管,即使甄別真假公布于眾,才是被偽造一方的當務之急。

人眼如果無法分辨,能不能用技術手段檢測Deepfake呢?

答案是可以的,能夠打敗魔法的也許還是魔法。

就在Deepfake開源不久,Facebook首席技術官Mike Schroepfer就發布博客宣布,公司正和微軟聯合來自麻省理工、牛津等大學的研究者,通過置辦“Deepfakes鑒別挑戰賽”,探索如何通過數據集和基準測試檢測Deepfake換臉視頻。

美國國防部也研究了一項名為Forensic的圖像鑒定技術。他們的思路是尋找圖片和視頻中的不一致性,例如不一致的燈光、陰影和相機噪音。

加州大學河濱分校的學者也提出了檢測Deepfake偽造圖像的新算法。同樣的,算法的一個組成部分是各種“遞歸神經網絡”,它能將有問題的圖像分割成小塊,然后逐像素觀察這些小塊。神經網絡經過訓練可以檢測出數千幅Deepfake圖像,它找到了贗品在單像素水平上的一些特質。

孵化自清華大學人工智能研究院的RealAI團隊也宣稱,由于Deepfake生成的造假視頻畫面會有不“自然”的紋理存在,他們通過海量視頻訓練神經網絡,讓其學習正常情況中的紋理特征,再以此檢測造假視頻中不一致的紋理。利用該技術,可以對造假視頻實現逐幀檢測,準確率高達90%以上。

原標題:《Deepfake首次參與戰爭!烏克蘭總統被偽造投降視頻,無奈推特辟謠》

本文為澎湃號作者或機構在澎湃新聞上傳并發布,僅代表該作者或機構觀點,不代表澎湃新聞的觀點或立場,澎湃新聞僅提供信息發布平臺。申請澎湃號請用電腦訪問http://renzheng.thepaper.cn。

- 報料熱線: 021-962866

- 報料郵箱: news@thepaper.cn

互聯網新聞信息服務許可證:31120170006

增值電信業務經營許可證:滬B2-2017116

? 2014-2025 上海東方報業有限公司