- +1

當一位牛津教授打破30年的沉默

作者 | 竺晶瑩

題圖 | 《模仿游戲》劇照

六年前,牛津大學的一個辦公室里,電話鈴聲劃破了寂寂的長廊,突然響個不停……

“請問是邁克爾·伍爾德里奇教授嗎?我們來自BBC,想跟你求證一些關于AI的言論。近日,埃隆·馬斯克說,AI在未來將摧毀人類。你怎么看呢?” 電話那頭傳來急促的聲音。

伍爾德里奇教授忍俊不禁,從他的學院派眼光看來,馬斯克的預測正如好萊塢迷戀AI統治世界的故事一樣,尚屬無稽之談。

隨著AI話題熱度越來越高,伍爾德里奇教授30年來平靜的研究生涯,自這通電話后開始被打破。他發現,相較艱深的技術分析,媒體顯然更傾向于報道人工智能下的反烏托邦場景。只是,事實并非如此。這也是為什么他近年來撰寫了《人工智能全傳》一書,試圖向大眾破除關于AI的迷思。

英國議員馬特·里德利曾盛贊他:“沒有人比伍爾德里奇更了解人工智能這項新技術的過去和現在,以及它給人們帶來的便利和危害。”

議員或許夸張,倒也并非過譽。時任牛津大學計算機學院院長的邁克爾·伍爾德里奇(Michael Wooldridge),與我進行了一次對談,希望幫我們厘清人工智能的發展簡史。對話中,教授從圖靈測試談到深度思考,算法偏見如何制約了機器,“技術奇點”有何缺陷。

伍爾德里奇教授被譽為英國計算機領域影響力最大的三位學者之一 / 圖片來源:牛津大學官網

祛魅AI

“這個世界已經有足夠多的擔憂能讓我們失眠,比如氣候變化、核武器,我不建議大家再擔心AI取代人類這種事了。” 伍爾德里奇教授無奈笑道,他的英式幽默有點冷。

在教授的回憶里,當時馬斯克表示AI可能摧毀人類后不久,斯蒂芬·霍金竟也警示大家,AI對于人類而言是個潛在的威脅。這讓他陷入了深思,為何像霍金這樣偉大的頭腦都作出了類似判斷。

他或許找到了部分原因。過去十年間AI的飛速進展,讓我們幻想未來幾十年AI研究仍能以一種夢幻的速度實現超越。但是,伍爾德里奇指出,人們往往忽視了過去取得的進步,僅局限于特定的領域以及具體的程序中,比如AlphaGo、自動翻譯。這會讓人誤以為,一個全知全能的擬人化AI快要降臨了。但能下圍棋的程序無法自動翻譯,強人工智能時代也不會那么快到來。因此,特定程序的研發進步,讓我們將樂觀的情緒擴散到了AI全面進展上,但實際上這只是千里之行所累積的跬步而已。

“人們錯誤地認為,如果機器可以在某方面比人類做得更好,那么它們在任何方面都超越了人類,顯然并非如此。一個程序若能比人類做得更好,那是它通過被大量訓練使得程序最優化,然后在一個精細的領域里達到頂尖水平。”

比馬斯克的言論更成體系的,大概是“技術奇點”(Technological Singularity)理論。20世紀50年代,計算機先驅馮·諾伊曼首次提出“奇點”,表述為一種可以撕裂人類歷史結構的能力。60年代,數學家I.J.古德首創“智能爆炸”,指智能機器在無需人工干預的情況下不斷設計出下一代。

2005年,美國發明家、預言學家雷·庫茲韋爾(Ray Kurzweil)在《奇點臨近》一書中大膽預測:科技正以史無前例的速度指數級發展,計算機將超越人類智能的各個方面。到2045年,奇點來臨時,人工智能將完全超越人類智能。奇點之后,如果人的智能完全轉移到計算機上,那么人將以軟件形式實現永生。

庫茲韋爾將歷史分為六個紀元,每一個紀元的出現,都是利用上一個紀元的進化成果。人類在進化中產生思維能力,繼而創造了技術,從簡單的機械化發展為成熟的自動化設備。而接下來就將進入人機文明的紀元,由于人類技術呈現指數型發展,像基因技術、納米技術、機器人技術都將呈現更大容量、更快速度與更強的知識分享能力。我們的人機文明將超越人腦的限制,奇點開始,并于第六紀元從地球拓展到全宇宙。

如果這段說明有點拗口,用伍爾德里奇教授的話來說就是,機器會不斷自我學習讓自己變得更聰明,而機器學習的速度遠遠超過生物。因此我們害怕,機器最終會脫離人類的控制,因為它將聰明到我們難以理解它,難以與它共處。

然而,伍爾德里奇指出了奇點理論有明顯的不足——沒有人致力于制造“奇點”;而這也不會在一夜之間發生,因為我們只有應用大量的科學與技術才能達到“奇點”,好比波音747的發明,就是一個無比漫長的工程學研究過程,而它在開發中必須首要考慮的就是,確保人類的安全。

“我并不擔心奇點的到來,因為我們目前并不知道如何從現有的AI,演化到通用人工智能(Artificial General Intelligence),這依舊是科學之謎。” 教授補充道。

盡管伍爾德里奇教授理性且克制地看待AI發展,但這并不代表他對于人工智能進步的觀點過于保守。事實上,AI簡史中有許多關鍵時刻令他感覺到興奮。

“如果你來挑選AI發展過程中最關鍵的三個時刻,會是什么?” 我問。

教授略一沉思,在他30余年的研究生涯里,見證過太多AI高光時刻,只挑三起事件,倒也為難。但他還是很快確認了對自己震撼最大的三個節點:1966-1972年,首臺采用了人工智能學的移動機器人Shakey在美國斯坦福國際研究所(Stanford Research Institute, SRI)被發明;2005年,自動駕駛汽車Stanley完成了132英里的Mojava沙漠路線,在DARPA超級挑戰賽上一舉奪冠;2016年,谷歌DeepMind研發的AlphaGo擊敗圍棋世界冠軍李世石。

伍爾德里奇進而解釋,當時斯坦福研究所團隊試圖制造一個自主機器人,你向它下達命令后,它得自己找到途徑達成任務,比如你讓它把箱子從這個角落搬到那個角落。而這需要許多步驟,首先它要聽懂你的指令,其次它要弄清怎么完成指令,再來它還要辨識真實世界的場景,你需要把這些所有元素都內置到一個機器人上。Shakey展現了人工智能的應用,但更揭示了我們在AI領域遠有更多路徑需要探索。

自主機器人Shakey / 圖片來源:Google

Stanley在2005年挑戰賽上的表現則證明無人駕駛技術的難點首次被突破。2004年第一屆挑戰賽上,沒有一輛自動駕駛汽車能行駛超過7英里,甚至很多車都沒開過起跑線。但沒想到,僅隔一年,伍爾德里奇記得至少有七輛車能夠自動駕駛140英里以上,只需按下按鈕,斯坦福大學開發的Stanley就可以在復雜的地形上平均每小時行駛約 20 英里。他想,那簡直就像第一次見證飛機飛行一樣。

無人駕駛汽車Stanley在2005年挑戰賽中奪冠 / 圖片來源:Google

AlphaGo在2016年在韓國首爾擊敗李世石,則超乎意料,學界本以為這種層次的技術在未來二十年才會發生,因此這是“深度學習”(Deep Learning)取得重大突破的明證。

AI迷思

那什么是所謂的“深度學習”呢?

如果用官方語言描述,那就是推動第三次神經網絡的關鍵技術。伍爾德里奇教授指出,這個人工智能中最古老的想法之一,在過去十年中才開始取得成果。我們從大腦結構中汲取了靈感來構建AI系統,人類大腦約有1000億個神經元彼此連接,那么類比在軟件中就是神經網絡。1990年的一個典型神經網絡可能只有約100個神經元,2016年先進的神經網絡已經擁有約100萬個神經元。

深度學習的意義在于不斷前進,構建更深的網絡層級、更龐大的神經元結構、更廣泛的神經元連接。

雖然AlphaGo是深度學習取得重大進展的標志之一,但它也存在缺點。比如一個拒絕為客戶提供銀行貸款的深度學習程序,無法告訴你它拒絕客戶的原因。此外,神經網絡的穩定性也存疑。如果對圖像進行細微修正,這對人類來說不影響圖片識別,但會導致神經網絡將其錯誤分類。因此,同樣的改圖方式可以影響程序對路標的識別,在無人駕駛汽車中,神經網絡就可能誤讀路標。

另一個常被提及的概念是“算法偏見”(Algorithmic Bias)。教授指出:“這并非算法的偏見,其實是算法繼承了人類的偏見。”

這一說法可以追溯到1970年代,為了提高招生流程的效率,倫敦圣喬治醫學院的Geoffrey Franglen博士編寫了一個“模仿人類評估員”的算法來篩選學生的入學申請,其初衷也是為了抹平招生委員會的個體偏見,交由系統來完成“公平”的篩選。結果卻適得其反,成功入學的申請者始終缺乏多樣性。

原來,算法被設定了一些無關因素,比如出生地和姓名,來權衡申請者。如果他們的名字不是白人姓氏,篩選流程就會對他們不利,光是沒有一個歐洲名字就會自動扣除申請者 15 分了。女性申請者平均要被扣掉3分。因此,算法只是在維持當時招生系統早已存在的偏見而已。

那么今天我們有希望解決算法偏見的問題嗎?

伍爾德里奇表示,AI的工作原理就是,程序通過不斷被訓練來作出判斷。假設一家銀行在設計程序來判斷客戶是否該獲得貸款。那么銀行需要展示大量貸款申請,并告訴算法,這是優質或劣質的申請。但關鍵在于,訓練算法的人本身就帶有自己都沒意識到的偏見,那么算法自然在大量習得數據的過程中也沾上了偏見。比如倫敦存在區域的“郵編歧視”,如果一個程序根據客戶住址來判斷他該不該獲得貸款,由于以往數據顯示偏遠社區的用戶償還貸款能力不佳,這時算法就傾向于判斷這類郵編的客戶不該被批準申請。

這么看來,只要人類社會的偏見不消除,算法世界的偏見也不會消失。不過,從1970年代至今,人們至少在消除種族歧視、倡導性別平權上的呼吁已經得到些許進展,而只有現實世界里的進展才會延伸到算法系統中。

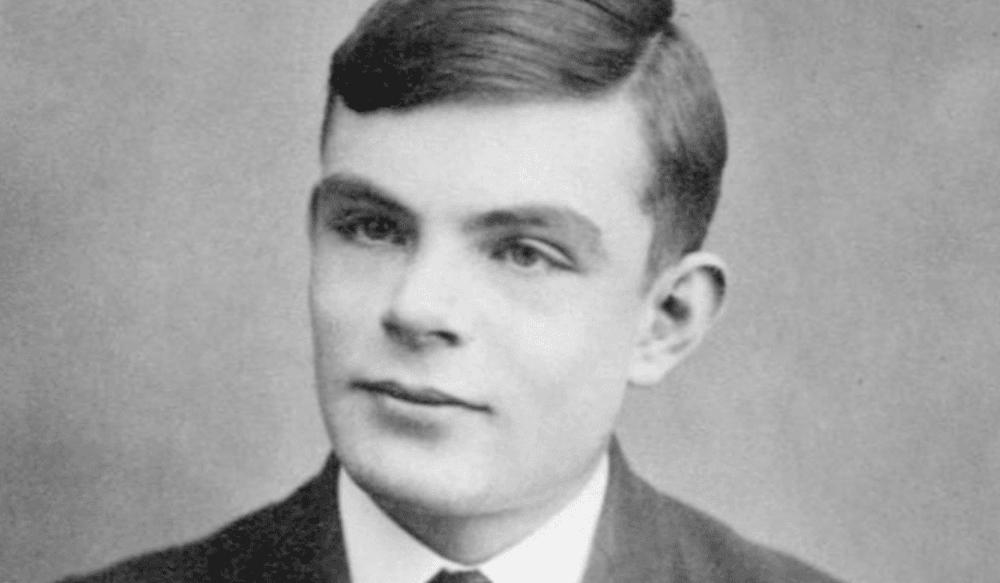

最終,這些關于機器能否思考的討論,必然會溯源到阿蘭?圖靈(Alan Turing)身上。1950 年,圖靈發表了一篇論文《計算機器與智能》,他提出了一個問題:“機器會思考嗎?”

開啟了人工智能時代的圖靈 / 圖片來源:Google

如果看過《模仿游戲》,那么對這位數學天才不會陌生。電影劇情中,二戰時期,英國軍情六處招募了一批人來破解德軍Enigma密碼機制造的暗號,但沒有人能在24小時內解出無數種可能性,而一天過后又是新的密碼。直到圖靈意識到,只有機器才能打敗機器。

伍爾德里奇指出電影有許多戲劇化的偏離現實情節,倒有助于大眾認識到圖靈。他說,圖靈幾乎是偶然發明了計算機,因為他1930年代在劍橋讀博期間就嘗試解決當時最重要的一個數學問題,為了解決它,圖靈最終發現他必須發明一種通用機器。戰后,他繼續建造自己的機器,這實際上是他數學夢想的載體。

隨即,圖靈就發明了一種測試來檢測機器是否會思考。英國有一種模仿游戲,一男一女分別位于不同房間,裁判需通過他們的手寫對話來猜誰是誰,但男女雙方都有可能在模仿對方。圖靈被游戲啟發,構思了一個思想實驗,將其中一位選手換成了計算機。如果計算機在編程之下,讓裁判無法斷定自己究竟是跟人還是機器對話,圖靈提出,那就有理由推斷出機器和人類一樣在“思考”。

這個思想實驗被稱作“圖靈測試”,仍是AI界最具爭議的話題之一。伍爾德里奇將這個測試形容為美妙,因為幾乎是圖靈開啟了AI時代。

而那也可以被視作對哲學的一種挑釁。

哲學家Daniel Dennett表示,圖靈測試本該是哲學對話的終結者,“與其無休止地爭論思考的終極本質和要義,我們為什么不都就這一點達成一致呢?即無論其本質是什么,任何東西只要通過了這一測試,當然就擁有思考能力。”

此為“算法與活法”系列報道第四篇,該系列聚焦科技時代下我們的生活如何被“異化”,通過與學者或專家的訪談以期獲得些許洞察。此前該系列篇目有:

《我們正掉入外賣陷阱》

《算法與活法:當你不再被需要》

《“人性第一”》

如對本稿件有異議或投訴,請聯系tougao@huxiu.com

End

原標題:《當一位牛津教授打破30年的沉默》

本文為澎湃號作者或機構在澎湃新聞上傳并發布,僅代表該作者或機構觀點,不代表澎湃新聞的觀點或立場,澎湃新聞僅提供信息發布平臺。申請澎湃號請用電腦訪問http://renzheng.thepaper.cn。

- 報料熱線: 021-962866

- 報料郵箱: news@thepaper.cn

互聯網新聞信息服務許可證:31120170006

增值電信業務經營許可證:滬B2-2017116

? 2014-2025 上海東方報業有限公司