- +1

人臉識別60年︱安巴·卡克:行動者們正在打開“黑箱”

制圖:馮婧

圍繞人臉識別技術有諸多討論:它的識別準確性如何?數據會“歧視”哪些群體?作為敏感信息,“人臉”是如何存儲的?使用后,數據會被銷毀嗎?

經過六十年的發展,它不再是加州一間小辦公室里技術探索者的古怪實驗,人們試圖去理解,“黑箱”里有什么。

“越來越多人開始關注,算法如何利用我的數據來定義我,它將如何影響政府和商家,他們會以此做出哪些關于我的決定”,長期關注數據法的研究者安巴·卡克(Amba Kak)在接受澎湃新聞(www.kxwhcb.com)專訪時這樣表示。

卡克是紐約大學AI Now研究中心的全球戰略及項目總監,今年9月,他們發布了一份報告,梳理全球范圍內人臉識別技術引發的爭議,并評估了現有數據保護法及相關條例的效力,報告提出,仍有諸多問題未能得到有效回應,即便是被稱為“史上最嚴格數據保護法”的歐盟《通用數據保護條例》(GDPR)。

澎湃新聞:談談這份報告的緣起吧。

安巴·卡克:差不多一年前,我們啟動了這個項目。當時我們能感受到,世界范圍內,圍繞生物識別——特別是人臉識別,各種討論達到了高峰。熱度既來自這項技術的大規模應用,也暗含人們對它的擔憂。人們期待,能有更針對性的法律規范這項技術。

實際上,全世界范圍內,大約有130個國家擁有數據保護法,它們都涵蓋了生物特征數據,一些地區有更針對性的法律,比如美國伊利諾伊州的《生物識別信息隱私法》(BIPA)、歐盟的《通用數據保護條例》(GDPR)。但深入研究,這些法律條文仍有局限,比如,它們仍然無法有效解決人臉識別技術的準確性、數據歧視等問題。

這份報告收錄了8個來自世界不同地區的案例,我們希望梳理目前生物識別技術在應用中的諸多困境。

澎湃新聞:人們對于人臉識別技術的擔憂似乎存在一些地區差異,比如,美國的研究和行動者聚焦在種族歧視問題,人臉識別技術對于少數族裔的誤識率很高,當它應用于警察執法會造成偏誤。而中國更關注數據隱私和安全性等問題。

安巴·卡克:確實有差異,但我認為,其中存在共性。

先談“歧視”,很有趣的一點,談及這個詞,很多人第一反應是種族,特別是美國,如你所說,目前很多研究都集中在這一領域,它確實引發了一些誤捕事件,所以才有了之后許多城市的禁令,警察執法不得使用這項技術。

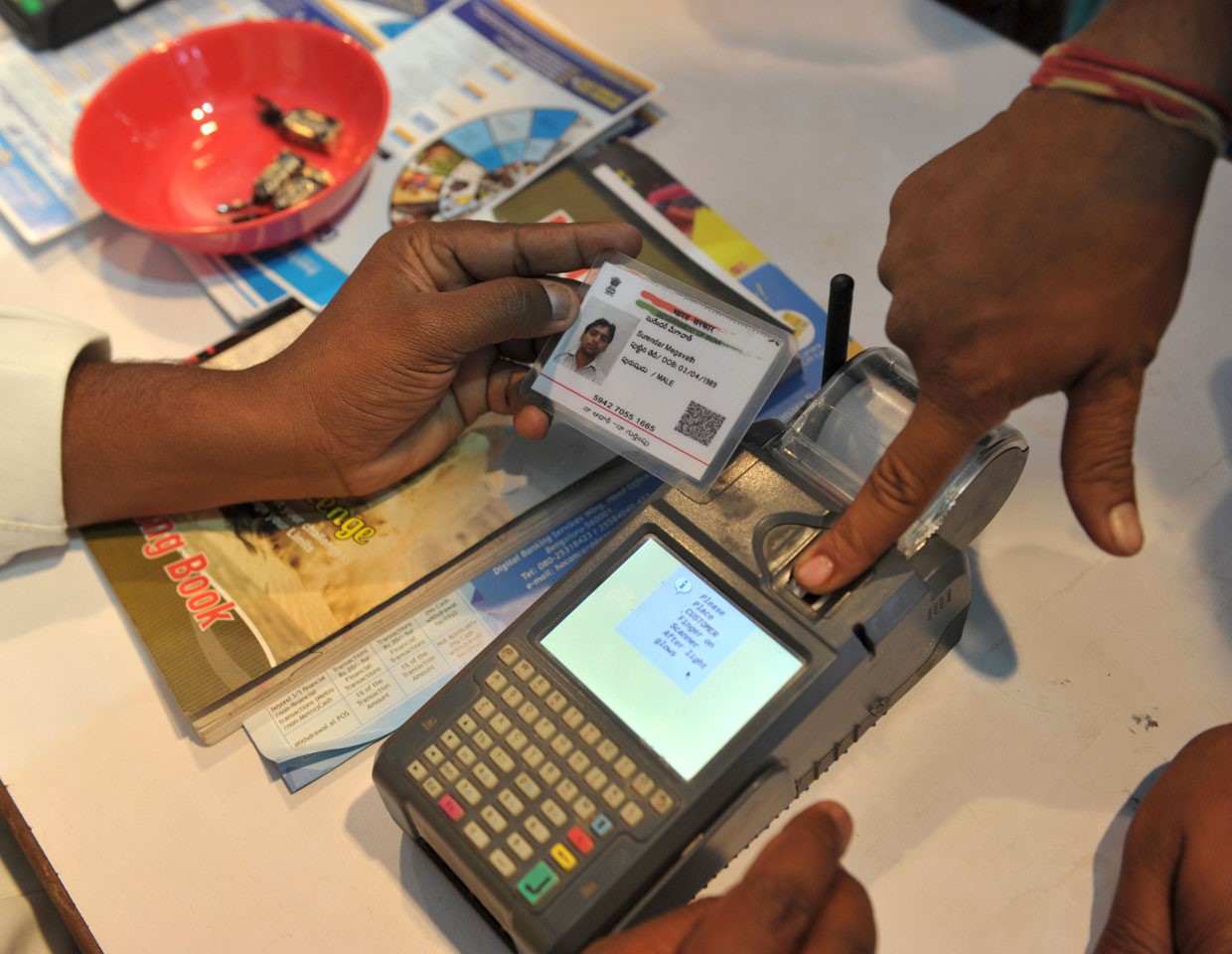

但“歧視”還會涉及更多群體,比如女性、老年人。舉個例子,我來自印度,2009年印度政府啟動了Aadhaar項目,計劃為11億人口建立一個生物特征數據庫,每個公民的指紋、虹膜,甚至人臉信息都將納入其中,作為公民身份的唯一標識符(編者注:identifier,指用來標識某個實體的一個符號,來源于計算機編程語言),與教育、醫療、保險、金融等社會生活的方方面面綁定。

Aadhaar的初衷之一是為了減少社會福利的冒領、漏洞,減少中間環節,避免因官員腐敗,救濟無法到達需要的人手中。但很快人們發現了各種問題。許多底層勞動者由于長期勞作,指紋嚴重磨損,難以被識別,無法獲得救濟。

Aadhaar打造了一套唯一身份系統,但這些群體卻被排斥在外。除此之外,Aadhaar計劃還有很多問題,比如數據安全,我們的報告中也有一章專門講Aadhaar計劃。

或許相較于“歧視”,更準確的詞是“排斥”(exclusion),如果你生活在一個人口結構并不那么多元的社會,種族歧視似乎離你較遠,不如想想排斥,你是否被某種系統排斥在外了。

Aadhaar計劃建立了一套生物特征數據庫。圖片來源:Getty

澎湃新聞:比如數字鴻溝也會造成排斥?新冠疫情期間,中國的“健康碼”發揮了很大作用,但對于一些不習慣使用智能設備的群體,他們的生活也遇到了障礙。

安巴·卡克:沒錯。幾乎每個地區都有數字鴻溝,可能是某些地區的網絡覆蓋率有限,也可能是某個人群不習慣使用智能設備。

Aadhaar使用唯一識別碼(UIDAI)與社會福利綁定,可以追問兩個問題,涉及到社會福利領取這種社會基礎服務時,是否可以保留其他“低技”的、非數字化的方式?技術的初衷是為了提高效率,但對于某些群體而言,它恰恰起到了相反作用。另一個問題是,當個人對識別結果存疑時,是否有申辯機制?

澎湃新聞:人臉識別的準確性引發了各種討論,技術供應商往往宣稱很高的準確性,但一些獨立測評顯示,對于某些群體誤識率更高,可以對準確性提出“行業標準”嗎?報告中提到了一點,立法者開始意識到需要對技術供應商進行審查,如美國國家標準技術研究院(NIST)會設置基準,他們有自己的數據集,可以進行獨立測試。

安巴·卡克:是的,比如NIST的“2019人臉識別供應商測試”(Face Recognition Vendor Test,FRVT),它會評估同一個算法對于不同人群的表現。

值得注意的是,這套標準可能只適用于美國獨特的社會人口結構,比如種族、年齡、性別等等。如果在亞洲、拉美地區,數據集和標準可能完全不同。

設置準入標準是正確的方向,允許專業機構對準確性進行評估。但目前,包括NIST等標準設置機構在內,他們提出的標準具有多大效力,學界也有不同意見。有研究者發現,一些已經通過了標準測試的算法,在實操環節仍然低于預期。

2018年底,倫敦警方曾使用安裝有攝像頭的面包車來監視街道安全,這在當時引發民眾抗議。圖片來源:視覺中國

澎湃新聞:2019年舊金山提出人臉識別禁令后,多個城市紛紛通過了類似的禁用措施,主要禁用范圍是警察執法。最近波特蘭也提出,禁止私人公司在公共場所使用這項技術。有人擔心,一刀切式的禁止是一種“技術恐懼論”。

安巴·卡克:這個問題非常有趣。

首先,媒體報道中使用了一個非常干脆的詞,“禁令”(Ban),但許多城市出臺的是類似“暫停令”(Moratorium),暫時叫停這項技術的應用,直到有更深入的研究,或更健全的法律,可以切實保障個人權利。

這一輪人臉識別禁用浪潮可能會造成一種印象——這是一個糟糕的技術,但我認為,恐懼論會讓人們遠離它,而非了解它。

這一輪禁令浪潮背后有很多討論會,有的由城市的市政部門組織,有的由公民團體組織。很多人試圖去理解“黑箱”里運行的技術——算法如何利用我的數據來定義我,并做出關于我的決定。

舉個例子,我們正在研究新冠疫情期間,全球的各種防疫軟件。中國有健康碼,用不同顏色區分你的安全級別,據我了解,持有綠碼者可以通行無阻,而紅碼就無法進入某些地方。人們會關心顏色為何發生變化,如果它對我的判斷有誤,我能否挑戰它,為自己申辯?

類似的討論在全球各處都能看到,越來越多,透明度和申辯機制都很重要。所以我并不贊同技術恐懼論,相反應該鼓勵人們“打開”黑箱。

澎湃新聞:目前,世界范圍內,很多數據保護法都強調了“同意”的重要性,但這份報告似乎持有不同觀點,為什么?

安巴·卡克:是的,同意并不重要,或者說,它并不如你想象中那么重要。

個人需要有知情權,了解數據具體的使用場景、使用目的,如何獲取、存儲、處理、銷毀。但“同意”并不等于你真的有選擇權。

現有的“同意”機制存在問題,比如,當你想要安裝一個App,手機會彈出的說明框,你可以選擇同意,但如果不同意就意味著你無法使用這個App。不要對“同意”有什么浪漫化的想象,它不能保護我們的權益,相反,它可能會被惡意曲解為一種“授權”。

無論從技術還是法律的專業背景上,個人與科技公司都是不對等的,保護個人信息安全不該是個人的責任,而應是政府的職責。所以相較于一個模糊而形式化的“同意”,政府需要更明確的法規,規定數據的獲取及使用。

人臉可以作為一種連接個體信息的標識符,與消費習慣、行蹤軌跡等互通。圖片來源:Flickr

澎湃新聞:最近,中國公布了《個人信息保護法(草案)》,并向社會征詢意見。有法律學者提及,需要限定人臉識別技術的使用目的,它應該被應用于身份驗證,而非其他商業性目的,比如用戶畫像和精準營銷。《歐盟通用數據保護條例》等法規中也提出了一些原則,比如“必要性原則”、“使用目的限定原則”,實際操作中,這些原則的效力如何?

安巴·卡克:可以拆分成兩個問題。

首先要警惕一種簡化的對比,認為“識別”(Identification)是高風險的,而身份“驗證”(Verification)是100%安全的,但就像我前面提到的那些因素,Aadhaar就是一種身份驗證,但很多人無法識別指紋。

使用目的限定原則(Purpose-limitation Principle)非常重要。比如,我可以將我的個人數據放心交給住房委員會,因為我清楚他們會如何使用我的數據。但如果數據泄露,或是被賣給了保險公司,他們可能會對我做出判斷,比如拒絕為我貸款。

這個設想很好,但在執行層面上看存在困難。如Google這樣的科技巨頭,業務涵蓋多個領域,彼此之間會不會進行數據互通?比如,我的健康數據會不會分享給保險公司,或者廣告精準營銷?所以實際操作層面,立法者、公民團體或許需要做更多實踐。

澎湃新聞:報告中提到了一個有趣的案例,國際紅十字會在分配人道主義救援時使用了生物識別技術,但他們決定放棄建立一個中心化的生物特征數據庫。中心化的數據庫存在哪些風險?

安巴·卡克:新冠疫情期間,你能看到中心化的數據庫,針對防疫它很有效。但它又存在風險性。一是數據安全,當所有敏感信息都存儲在一個中心化的服務器上,如果遭到攻擊,很容易危及整個數據庫。

第二層風險,我們稱之為“蜂蜜罐”(honeypot),它與前面提到的“使用目的限定原則”存在沖突——將不同來源的數據整合,這件事情誘惑太大了。

這也是紅十字會案例中,人們的擔憂:他們有必要使用生物識別技術,以提升發放救援物資的效率。但試想,如果你擁有一個關于難民的中心化的生物特征數據庫,會有太多力量想要訪問這些數據。所以紅十字會通過技術手段,盡量減少生物識別技術的實際保留。

澎湃新聞:報告的最后一章提到了一個案例,紐約的一處公立學校,家長們反對校方以安保為名使用人臉識別技術。針對這項技術的應用倫理,社區在其中可以起到什么樣的作用?

安巴·卡克:我們想通過這個案例告訴大家,行動是可能的。

這個案例中,家長們討論的都是最具體的問題,而不再是一些看起來時髦卻有些抽象的詞匯,比如隱私和監控。孩子的日常生活會面臨哪些改變,是否有其他更好的方式使用這筆資金。

實際上,在全球關于人臉識別的討論中,我們能看到這種轉向,從抽象的概念走向具體的問題。

再談談印度。進行國際比較時,我們發現,很難在當地語言中找到一個詞匯來表達“隱私”,這個詞當然是存在的,只是人們在日常生活中很少會用到它。當你去問一個普通印度人,“人臉識別攝像頭會侵犯你的隱私嗎”,或許他無法明白你在說什么。

這份報告發布后,很多人會問我,“你對我們國家的生物識別技術法律有什么建議嗎?”這個問題太大了,不如看看周圍,如就業、居住、子女教育,人臉識別技術對你的生活產生了哪些影響?你同意它對你的判斷和決策嗎?

(市政廳得到AI Now授權,近期將翻譯報告中的部分內容,呈現不同城市的行動與思考。)

制圖:白浪

- 報料熱線: 021-962866

- 報料郵箱: news@thepaper.cn

互聯網新聞信息服務許可證:31120170006

增值電信業務經營許可證:滬B2-2017116

? 2014-2025 上海東方報業有限公司